PROTEUS:通过单张图片让人物进行实时唱歌和说话

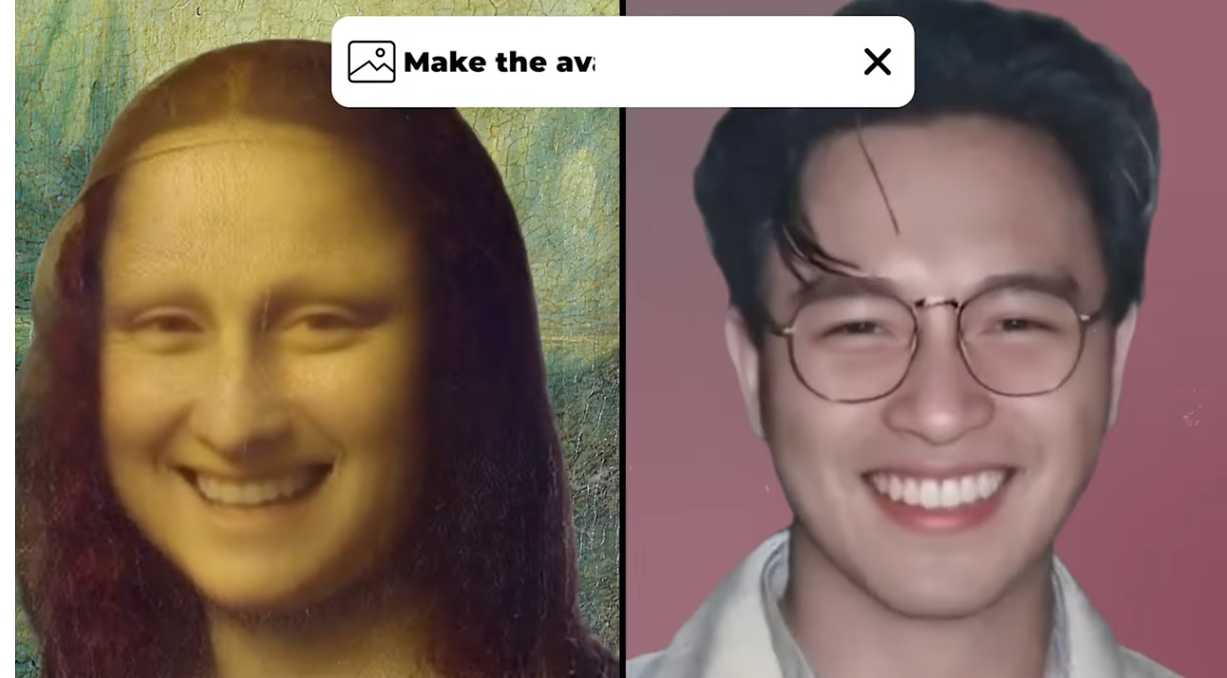

PROTEUS 是由斯坦福大学的研究人员和 Apparate Labs 共同开发的一款人工智能模型。它能够通过单张照片生成逼真、具有表现力的虚拟人物,并实现实时的唱歌和说话功能。

核心特性

实时生成逼真人物

PROTEUS 能够从单一图像生成笑容、说唱、唱歌、眨眼、微笑、说话等效果,展现复杂的面部表情和身体动作。

高帧率视频流

支持 100+ FPS 的视频流,实现实时处理,保证互动的流畅性和自然性。

多模态交互

兼容语音、文本和图像等多种数据形式,能在不同场景中进行自然和直观的交互。

自定义和应用

高度可定制的架构设计,适用于多个领域和应用场景,满足个性化需求。

技术架构

PROTEUS 采用了潜在扩散模型和先进的 Transformer 架构,在潜在空间中进行数据处理,高效生成复杂图像。进一步改进的架构和算法实现了每秒超过 100 帧 的生成速度。

应用场景

个性化虚拟助理

提供日常事务处理、日程管理、信息查询等服务。

虚拟宠物

创造具有逼真外观和丰富情感的虚拟宠物。

情感支持

生成情感支持型虚拟人物,提供心理安慰和支持。

客户服务

生成虚拟客服代表,提供即时高效的客户支持。

教育和培训

生成虚拟教师或培训师,提供个性化教育和培训。

视频游戏角色定制

为游戏开发者提供高度可定制的游戏角色。

影视和娱乐

用于生成逼真的虚拟演员和角色,降低制作成本。

市场营销和广告

生成虚拟代言人,进行产品推广和品牌宣传。

社交媒体和虚拟社交

在社交平台上生成虚拟形象,丰富社交体验。

愿景与未来发展方向

PROTEUS 的愿景是提供一个可通过语音控制的视觉化体现,作为人工对话实体的直观接口,使用户能够与虚拟形象进行自然的对话和互动。这项技术的安全提供和早期 API 访问权限将向选定的开发者开放。PROTEUS 在 Twitch 直播中已有多个应用案例,展示了其在实时互动场景中的应用潜力。通过 API,PROTEUS 可以在任何应用中调用使用,为各行业带来创新的虚拟人物交互体验。

总结

PROTEUS 是一款先进的人工智能模型,适用于各种应用场景,包括虚拟助理、虚拟宠物、情感支持、客户服务、教育培训、视频游戏、影视娱乐、市场营销和社交媒体。其核心特性包括实时生成逼真人物、高帧率视频流、多模态交互和高度可定制的架构。通过潜在扩散模型和 Transformer 架构,PROTEUS 实现了高效的图像生成。

目标受众:开发者、游戏设计师、营销人员、教育工作者和需要虚拟交互的用户。

使用场景:需要生成逼真虚拟人物的各类应用,如虚拟助理、虚拟宠物、教育培训、市场营销等场景。

通过 PROTEUS,用户可以在各种场景中实现自然、直观的虚拟人物交互体验。

#社交媒体