欢迎来到AI超元域

在人工智能浪潮中,多模态大模型的发布标志着一个新的起点。特别是Mistral AI发布的Pixtral 12B,更是为行业树立了新标杆。那么这款模型有哪些独特之处,它又是如何实现视频识别的呢?

什么是Pixtral 12B?

Pixtral 12B有何独特之处?

Pixtral 12B是Mistral系列的首款开源多模态大模型。它结合了文本与图像处理能力,这标志着Mistral AI在人工智能领域迈出了重要的一步。它不仅基于之前的Mistral Nemo 12B模型,而且注入了120亿参数和4亿视觉适配器参数,显著增强了处理视觉数据的能力。

模型技术参数亮点在哪里?

- 隐藏维度:14,336个

- 注意力头:32个

- 词汇量:增加至130,072个词元,并含有三个专用于图像处理的特殊词源。

- 位置嵌入:使用2D旋转位置嵌入增强对图像空间关系的理解。

如何在本地部署Pixtral 12B?

部署环境及硬件要求是什么?

在Ubuntu系统上部署该模型需要高配置的硬件支持,例如两张RTX A6000显卡。每张显卡拥有48G显存,以确保模型能够顺畅运行。

具体步骤如何进行?

- 安装vLLM:

- 在终端中使用命令安装:

pip install vLLM

- 在终端中使用命令安装:

- 运行Pixtral 12B:

- 下载依赖并配置运行环境。

- 使用:

vLLM以服务形式运行模型(端口为8000)。

- 调用模型:

- 使用OpenAI的Python库进行调用。

- 设置base URL为运行的vLLM服务的地址,并使用Python库导入模型。

多模态模型如何进行视频识别?

如何使用文本和图像进行分析?

通过将视频抽帧,Pixtral 12B可对每一帧进行分析。使用cv2库从视频中每秒抽取图像,并对其进行分析以识别指定目标。

实际应用中的价值是什么?

例如,Pixtral 12B可以在监控中快速查找指定人物,帮助节省人力并提高准确性。通过多模态模型,实现了对监控画面的实时分析,非常大地提升了数据处理效率。

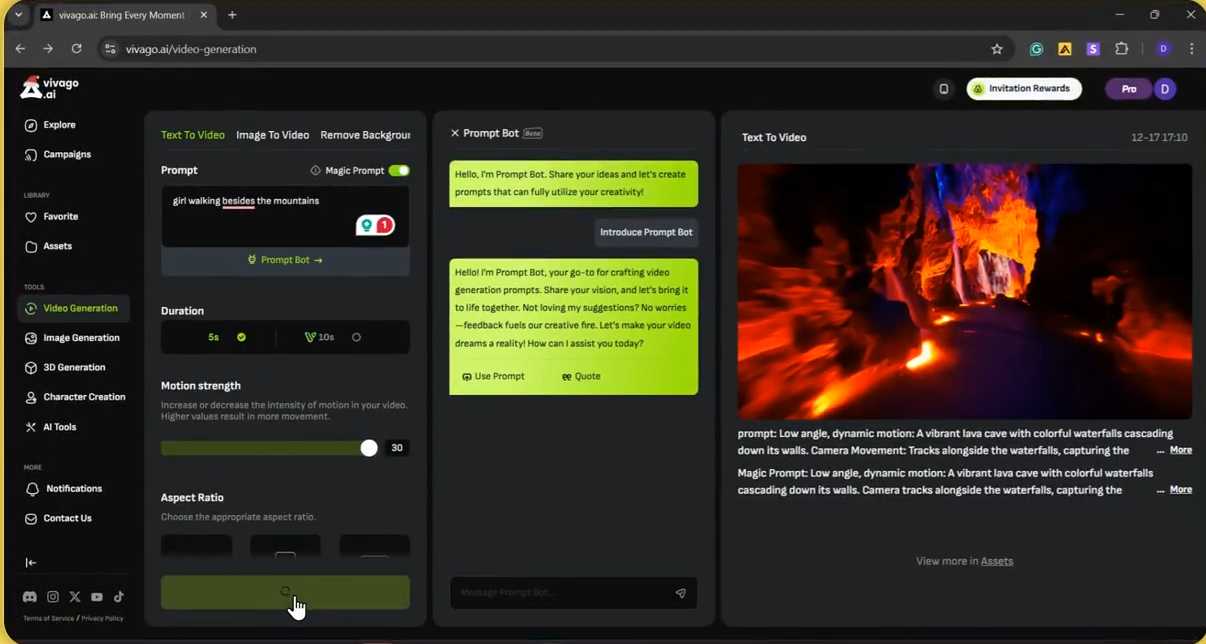

实际操作演示

如何在chainlit中实现图像识别?

- 上传图像:

- 使用base64编码上传。

- 描述图像内容:

- 模型迅速返回详细描述。例如,一只金毛犬在公园。

视频识别的应用实例

模型可识别出视频中的特定人物或物体,如“小男孩与父母”或“卡其裤男士”,并准确给出其在视频出现的时间段。

感想

鲁迅风格传承的思考:我认为,与其说 Pixtral 12B 是技术上的革新,不如说是在人类与机器之间建立了理解的桥梁。这不仅是对图像与文本的处理,更是对人机交互的一次提升。未来,人工智能的潜力不可估量,它们将在更广阔的领域中大展拳脚。

© 版权声明

文章版权归作者所有,未经允许请勿转载。