在当今快速发展的人工智能领域,拥有一个强大且灵活的 API 接口已经成为许多开发者和企业的共同需求。今天,我很高兴向大家介绍一个令人兴奋的新项目——KIMI API。这是一个兼容 OpenAI 接口的 API 服务,提供了高速流式输出、多轮对话、联网搜索、长文档解析和图像解析等多种强大功能。本文将详细介绍 KIMI API 的特点、部署方法及其在各种应用中的潜力。仅供学习使用,请勿商业使用!!

什么是 KIMI API?

KIMI API 是由月之暗面科技有限公司开发的人工智能助手,设计理念是与 OpenAI 接口完全兼容。KIMI API 提供了以下主要功能:

- 高速流式输出:实现了低延迟、高速响应,适用于需要快速交互的应用场景。

- 多轮对话:支持上下文连续的多轮对话,使得对话更加自然流畅。

- 联网搜索:可以实时搜索互联网信息,提供更全面的回答。

- 长文档解析:能够解析长文档,提取关键信息,适用于各类文档处理场景。

- 图像解析:支持图像内容解析,适用于需要图像识别和描述的应用。

KIMI API 的主要优势

- 兼容性强:与 OpenAI 的接口完全兼容,开发者可以轻松迁移现有项目。

- 多功能集成:集成了对话补全、文档解读、图像解析等多种功能,满足不同应用场景需求。

- 高效部署:支持 Docker、Docker Compose、Render、Vercel 等多种部署方式,部署简单快捷。

- 免费使用:项目为纯粹的研究交流学习性质,提供免费使用,不接受任何资金捐助和交易。

如何部署 KIMI API?

部署 KIMI API 非常简单,无论是使用 Docker 还是其他方式,都能轻松上手。以下是使用 Docker 部署 KIMI API 的简要步骤:

-

拉取 Docker 镜像并启动服务

docker run -it -d --init --name kimi-free-api -p 8000:8000 -e TZ=Asia/Shanghai vinlic/kimi-free-api:latest -

查看服务实时日志

docker logs -f kimi-free-api -

重启或停止服务

docker restart kimi-free-api docker stop kimi-free-api

此外,还可以通过 Docker Compose、Render、Vercel 等多种方式部署,具体步骤请参考官方文档。

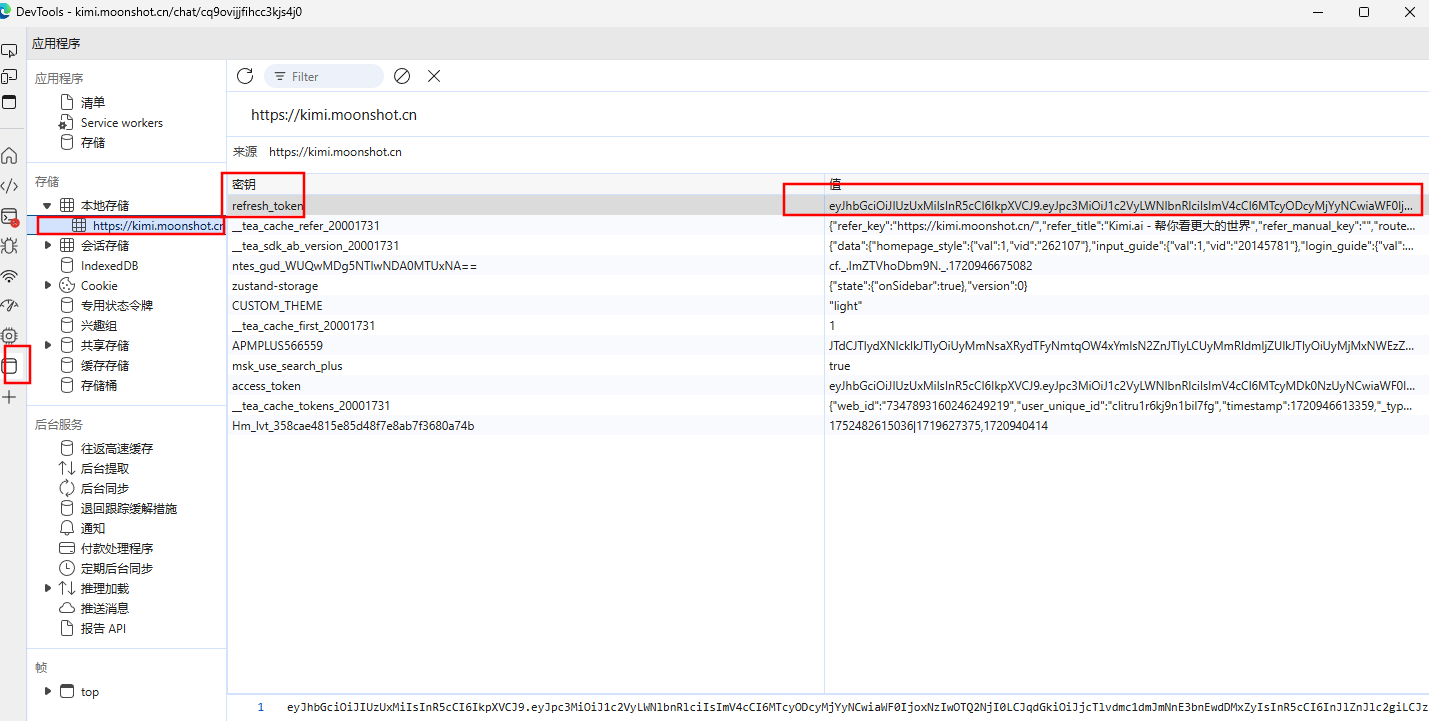

如何获取refresh_token

如何使用 KIMI API?

使用 KIMI API 进行对话补全非常简单,只需发送一个包含对话内容的 POST 请求即可。例如:

POST /v1/chat/completions

Authorization: Bearer <你的_refresh_token>

Content-Type: application/json

{

"model": "kimi",

"messages": [

{

"role": "user",

"content": "测试"

}

],

"use_search": true,

"stream": false

}应用场景

KIMI API 可以广泛应用于以下场景:

- 智能客服:基于多轮对话和联网搜索功能,提供更智能的客户服务解决方案。

- 教育与培训:利用长文档解析功能,为学生和教师提供精准的学习资料解析。

- 内容创作:通过图像解析和对话补全,辅助内容创作者生成高质量的文章和图像描述。

- 企业自动化:集成到企业内部系统,提高工作效率和自动化水平。

结语

KIMI API 是一个功能强大且灵活的人工智能助手,凭借其兼容性强、多功能集成和高效部署的特点,为开发者和企业提供了一个理想的解决方案。无论你是希望改进现有项目,还是探索新的应用场景,KIMI API 都能助你一臂之力。

如果你对 KIMI API 感兴趣,欢迎访问 KIMI API GitHub 项目页面 获取更多信息。让我们一起探索人工智能的无限可能!

希望这篇文章能够帮助你更好地了解 KIMI API 项目,并激发你对其应用的兴趣。如果你有任何问题或需要进一步的帮助,请随时联系我。

© 版权声明

文章版权归作者所有,未经允许请勿转载。